Google julkaisi 2. huhtikuuta 2026 Gemma 4 -malliperheen. Se on kokoelma avoimia kielimalleja, jotka perustuvat samaan tutkimukseen kuin Googlen kaupallinen Gemini 3, mutta ovat vapaasti ladattavissa ja käytettävissä. Ensimmäistä kertaa Gemma-sarjan historiassa mallit julkaistiin Apache 2.0 -lisenssillä, mikä poistaa kaikki kaupalliset rajoitukset.

Tämä tarkoittaa myös sitä, että nyt voit ajaa AI-agentteja paikallisesti omalta koneeltasi, ilman että mitään dataa lähtee ulospäin. Aiemmin tässä käyttötapauksessa piti turvautua kiinalaisiin malleihin. 🤖

Mikä on Gemma 4?

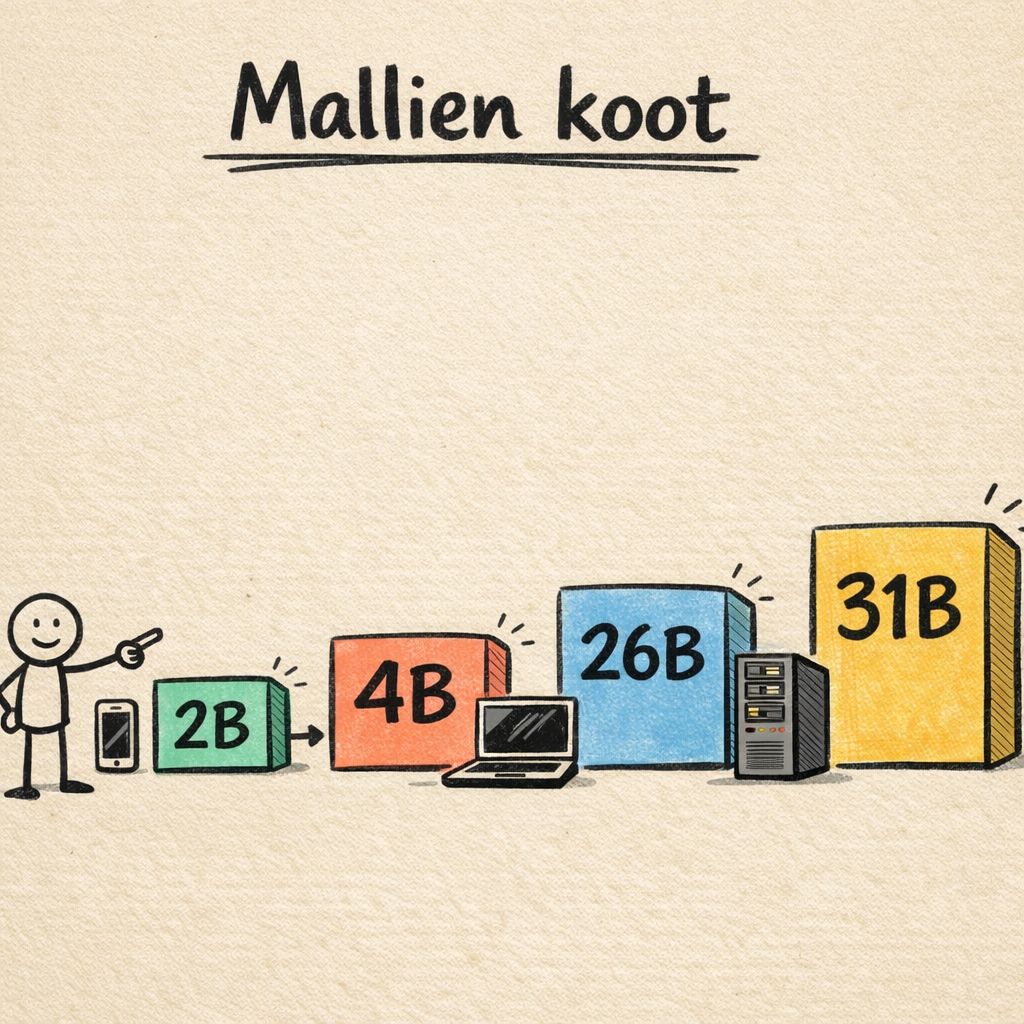

Gemma 4 on neljän mallin perhe, joka kattaa kaikki kokoluokat älypuhelimesta palvelimeen.

Malli | Aktiiviset parametrit | Kokonaisparametrit | Konteksti | Modaliteetit |

|---|---|---|---|---|

E2B | 2,3 miljardia | 5,1 miljardia | 128K tokenia | Teksti, kuva, ääni, video |

E4B | 4,5 miljardia | 8 miljardia | 128K tokenia | Teksti, kuva, ääni, video |

26B MoE | 3,8 miljardia (aktiiviset) | 25,2 miljardia | 256K tokenia | Teksti, kuva, video |

31B Dense | 30,7 miljardia | 30,7 miljardia | 256K tokenia | Teksti, kuva, video |

E2B ja E4B ovat pieniä malleja, jotka pyörivät puhelimessa tai kannettavassa. Ne tukevat myös äänen tunnistusta, mikä on harvinaista tämän kokoluokan malleissa.

26B MoE on Mixture-of-Experts -malli, jossa vain 3,8 miljardia parametria aktivoituu kerrallaan, vaikka kokonaiskapasiteetti on 25,2 miljardia. Käytännössä tämä tarkoittaa, että saat lähes 31B-mallin laadun murto-osalla laskentakuluista.

31B Dense on perheen lippulaiva. Kaikki parametrit ovat aina käytössä, ja se saavuttaa parhaat tulokset kaikissa testeissä.

Kaikki mallit julkaistiin Apache 2.0 -lisenssillä. Tämä on iso muutos edelliseen Gemma-sarjaan verrattuna, jossa oli oma lisenssi käyttäjämäärärajoituksineen. Nyt voit käyttää Gemma 4:ää kaupallisesti ilman rajoituksia tai lupamenettelyjä.

Mallit perustuvat samaan tutkimukseen kuin Googlen kaupallinen Gemini 3. Arkkitehtuurin erityispiirteitä ovat hybrid attention (liukuva ikkuna yhdistettynä globaaliin kontekstiin) ja Per-Layer Embeddings, joka antaa jokaiselle kerrokselle oman upotustaulun. Treningdata kattaa yli 140 kieltä ja sisältää tekstiä, koodia, kuvia ja ääntä. Datan katkaisupäivämäärä on tammikuu 2025.

Tulokset ja vertailu kilpailijoihin

Gemma 4:n tulokset ovat dramaattinen parannus edelliseen sukupolveen verrattuna. Gemma 3 27B sai GPQA Diamond -testissä 42,4 prosenttia. Gemma 4 31B saa 84,3 prosenttia. AIME 2026 -matematiikkakilpailussa hyppy on vielä suurempi: 20,8 prosentista 89,2 prosenttiin. Codeforces-koodauskilpailun ELO nousi 110:stä 2150:een.

Keskeiset benchmark-tulokset

Testi | 31B Dense | 26B MoE | E4B | E2B |

|---|---|---|---|---|

MMLU Pro (yleistieto) | 85,2 % | 82,6 % | 69,4 % | 60,0 % |

GPQA Diamond (tiede) | 84,3 % | 82,3 % | 58,6 % | 43,4 % |

AIME 2026 (matematiikka) | 89,2 % | 88,3 % | 42,5 % | 37,5 % |

LiveCodeBench v6 (koodi) | 80,0 % | 77,1 % | 52,0 % | 44,0 % |

Codeforces ELO | 2 150 | 1 718 | 940 | 633 |

MMMU Pro (visio) | 76,9 % | 73,8 % | 52,6 % | 44,2 % |

26B MoE -mallin tulos on erityisen kiinnostava. Se saavuttaa LMArena-yhteisöarvioinnissa 1 441 pistettä, kun 31B Dense saa 1 452. Ero on häviävän pieni, mutta MoE-malli käyttää vain neljäsosan laskennasta.

Miten vertautuu kilpailijoihin?

Gemma 4 31B on kolmanneksi paras avoin malli Arena AI -listalla, mutta kilpailu on tiukkaa.

Osa-alue | Paras malli | Gemma 4:n sijoitus |

|---|---|---|

Koodaus (LiveCodeBench) | Qwen 3.5 | Jää jälkeen |

Matematiikka (AIME) | Gemma 4 31B / Qwen 3.5 | Tasavertainen |

Pitkä konteksti (10M+ tokenia) | Llama 4 Scout | Selvästi jäljessä (256K vs. 10M) |

Monikielisyys | Qwen 3.5 (201 kieltä) | Jää jälkeen (140 kieltä) |

Mobiilisovellus | Gemma 4 | Johtava |

Lisenssi | Gemma 4 (Apache 2.0) | Johtava |

Kiinalaiset mallit Qwen 3.5, GLM-5 ja Kimi K2.5 johtavat useilla osa-alueilla. Gemma 4 ei ole absoluuttinen ykkönen missään yksittäisessä testissä, mutta kokonaisuutena se on kilpailukykyisin amerikkalainen avoin malli.

Mitä yhteisö sanoo?

Googlen Logan Kilpatrick julkaisi Gemma 4:n X:ssä sanoin: "Byte for byte the most capable open models in the world." Postaus keräsi yli 5 500 tykkäystä.

Demis Hassabis, Google DeepMindin toimitusjohtaja, vihjasi julkistuksesta etukäteen neljällä timanttiemojilla. GPQA Diamond -tulokset selittävät valinnan.

HuggingFacen tiimi kommentoi, että mallit ovat niin hyviä suoraan paketista, että hienosäätöesimerkkejä oli vaikea löytää. Tämä on harvinainen kehitysvaihe avoimille malleille.

Kritiikkiäkin löytyy.

Trending Topics -julkaisu otsikoi artikkelinsa "Google's New Open Source LLMs Lag Behind Chinese Competitors". Väite pitää paikkansa koodauksessa ja monikielisyydessä. Qwen 3.5 voittaa molemmilla osa-alueilla.

The Register huomautti, että julkaisussa käytetyt benchmark-tulokset ovat pääosin Googlen omia. Riippumattomia vertailuja oli julkaisupäivänä vähän. Artificial Analysis kuitenkin vahvisti GPQA Diamond -tuloksen 85,7 prosentiksi omissa testeissään, mikä on lähellä Googlen ilmoittamaa lukua.

Kehittäjäyhteisön yleinen tunnelma on positiivinen. Eniten kiitosta saavat Apache 2.0 -lisenssi, mobiilituki ja se, että kaikki suuret inferenssimoottorit (Ollama, llama.cpp, MLX, vLLM) tukivat mallia heti julkaisupäivänä.

Mihin Gemma 4 sopii ja mihin ei?

Vahvuudet

Paikalliset AI-agentit. Gemma 4 tukee natiivisti function callingia ja strukturoitua JSON-tulostetta. Voit rakentaa autonomisia agentteja, jotka kutsuvat API-rajapintoja ilman erikoisharjoittelua. Android-kehittäjille malli integroituu suoraan Android Studioon offline-koodiassistentiksi.

Multimodaalinen analyysi. Kaikki mallit ymmärtävät kuvia. Isommat mallit käsittelevät myös videota (60 sekuntia). Pienimmät mallit tunnistavat puhetta. Käyttötapauksia ovat esimerkiksi kuvien luokittelu, GUI-elementtien paikantaminen ja dokumenttien analysointi.

Yksityisyys ja kustannustehokkuus. Data pysyy omalla koneella. Ei API-kuluja. E2B pyörii puhelimessa, E4B 8 gigatavun kannettavassa. Yritykselle tämä tarkoittaa, että arkaluontoisen datan käsittely onnistuu ilman pilviriippuvuutta. Tämä on sama periaate jota käsittelimme tekoäly käyttää tietokonettasi -artikkelissa: automaatio siirtyy pilvestä omalle koneelle.

Pitkä konteksti. 256 000 tokenin konteksti-ikkuna isoimmissa malleissa riittää kokonaisen koodipohjan tai pitkän dokumentin käsittelyyn kerralla.

Heikkoudet

Koodaus jää jälkeen. Qwen 3.5 on selvästi parempi koodauskilpailuissa ja käytännön ohjelmointitehtävissä. Jos pääkäyttötarkoitus on koodaus, Qwen on parempi valinta.

Konteksti-ikkuna on rajallinen verrattuna joihinkin kilpailijoihin. Llama 4 Scoutin 10 miljoonan tokenin konteksti on ylivoimainen kokonaisten koodipohjien käsittelyyn. Gemma 4:n 256K riittää useimpiin käyttötarkoituksiin, mutta ei kaikkiin.

Monikielisyys. 140 kieltä kuulostaa paljon, mutta Qwen 3.5 tukee 201 kieltä. Suomen kielen tukea ei ole erikseen vahvistettu benchmarkeissa.

Äänituki vain pienissä malleissa. E2B ja E4B tunnistavat puhetta, mutta isommat 26B ja 31B mallit eivät.

Kenelle suosittelen?

Jos rakennat AI-agentteja paikalliseen käyttöön, kuten vaikkapa Openclaw, tai tarvitset multimodaalisen mallin Apache 2.0 -lisenssillä, Gemma 4 on vahvin vaihtoehto tällä hetkellä. Jos tarvitset parasta mahdollista koodausapua tai äärimmäisen pitkää kontekstia, katso Qwen 3.5:tä tai Llama 4:ää.

Gemma 4 + OpenClaw: AI-agentit täysin lokaalisti

Yksi Gemma 4:n kiinnostavimmista käyttötapauksista on yhdistää se paikalliseen AI-agenttiin kuten OpenClaw tai sen kevyempään versioon NanoClaw.

OpenClaw on avoimen lähdekoodin AI-agentti, joka osaa käyttää tietokonettasi: selata verkkosivuja, muokata tiedostoja, ajaa komentoja ja hallita sovelluksia. Olemme käsitelleet sitä kattavassa oppaassamme. NanoClaw on sama idea 500 rivillä koodia, kuten kerroimme Karpathyn Claws-analyysissa.

Molemmat agentit tukevat Ollamaa taustamallina. Tämä tarkoittaa, että voit nyt pyörittää koko agenttijärjestelmän omalla koneellasi ilman pilviyhteyttä ja ilman API-kuluja.

Alla on selkeä ohjeistus siitä miten pääset liikkeelle oman Gemman pyörittämisessä 👇

Käytännössä tämä yhdistelmä sopii erityisesti tilanteisiin, joissa data on arkaluontoista tai verkkoyhteys epävarma. Esimerkiksi yrityksen sisäisten dokumenttien käsittely, koodin refaktorointi tai toistuva automaatiotehtävä.

Gemma 4:n natiivi function calling tekee agenttiyhteistyöstä sujuvaa. Malli ymmärtää työkalukutsut suoraan ilman erillisiä kiertoteitä. Tämä on sama agenttiarkkitehtuurin periaate, jota olemme käsitelleet kuuden kerroksen oppaassamme: kielimalli on agenttijärjestelmän ydin, ja Gemma 4 on ensimmäinen avoin malli joka tukee tätä roolia kunnolla pienemmissäkin kokoluokissa.

Jos et ole vielä kokeillut AI-agentteja, ensimmäisen AI-työtekijän luominen on hyvä lähtökohta. Gemma 4 tekee siitä nyt mahdollista ilman pilvitiliä.

Näin otat Gemma 4:n käyttöön

Tilaa AI-Sanomien Plus-jäsenyys niin näet loput sisällöstä

Tilaamalla AI-Sanomien maksullisen jäsenyyden saat pääsyn kaikkiin uutiskirjeen sisältöihin sekä tuet Suomen parasta AI-mediaa.

Tilaa jäsenyys tästä! Voit lopettaa koska tahansa.Miksi tilaus kannattaa?:

- Pääsy kaikkiin maksullisiin oppaisiin

- Webinaari-tallenteet

- Näet kaikki uutiskirjeen sisällöt, uudet AI-työkalut sekä vinkit tekoälyn käyttöön.

- GPT4o-botti: Tämä on tietoturvallinen versio ChatGPT:stä, jossa syöttämääsi dataa ei käytetä kielimallin kouluttamiseen.

- Tuet Suomen parasta AI-mediaa 😊